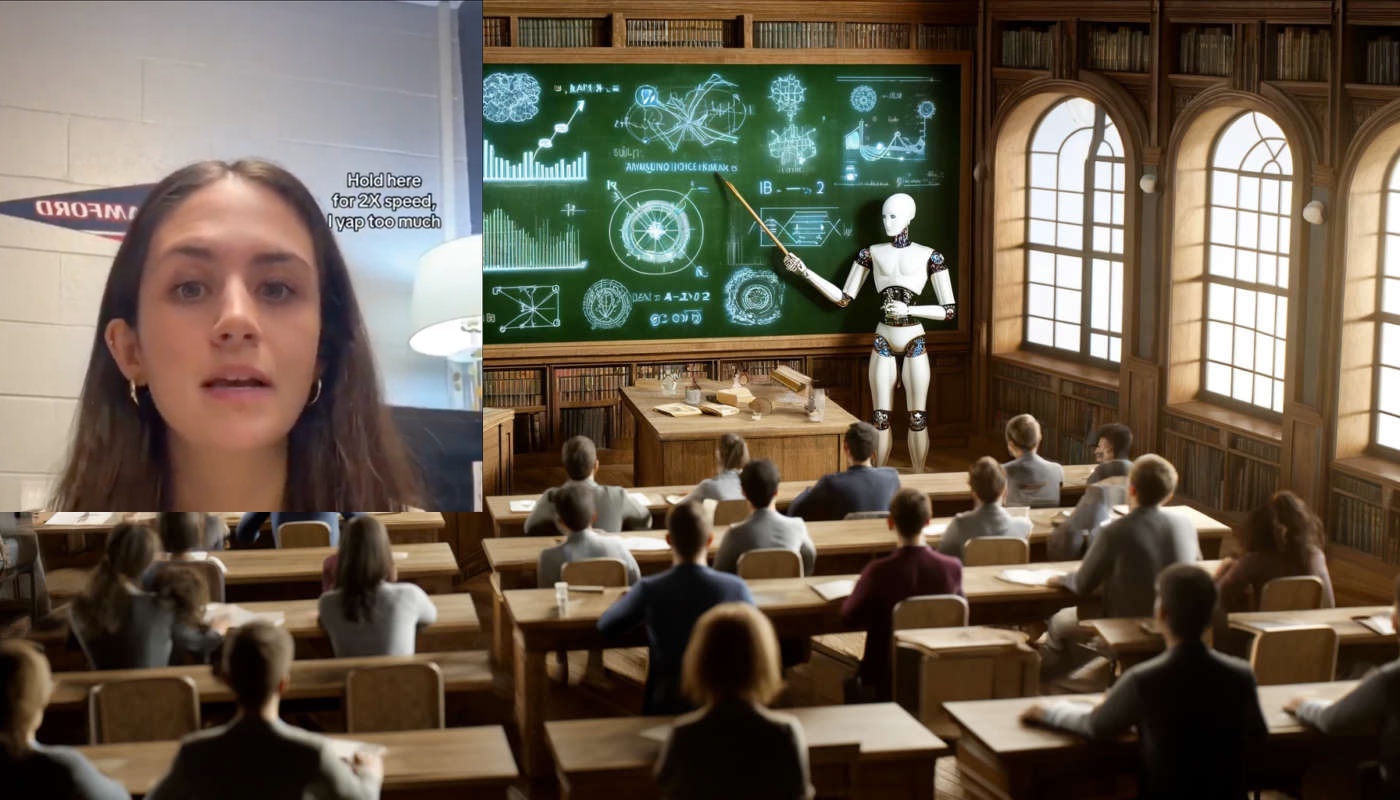

Una studentessa scopre che il suo professore usa l’IA per preparare le lezioni e chiede il rimborso della retta. È solo l’inizio di un dibattito più grande.

Il professore usa ChatGPT per preparare le lezioni ed Ella Stapleton, studentessa della Northeastern University chiede un rimborso di 8.000 dollari dopo averlo scoperto, la colpa è stata per generare materiale didattico con l’AI, il caso ha sollevato un acceso dibattito sull’uso dell’intelligenza artificiale nell’istruzione superiore (e non solo).

Indice dei contenuti

Il caso: quando l’AI entra in aula

Durante il suo ultimo anno di studi alla Northeastern University, Ella Stapleton si è trovata di fronte a qualcosa che l’ha lasciata perplessa, poi indignata: i materiali del corso di comportamento organizzativo – lezioni, slide e appunti – presentavano tracce evidenti di essere stati generati da un’intelligenza artificiale. Non solo frasi che suonavano artificiali, ma vere e proprie istruzioni lasciate intatte, tipiche dei prompt di ChatGPT, come “espandi tutte le aree. Sii più dettagliato e specifico”, quasi come se il professore avesse copiato e incollato direttamente il testo suggerito dall’IA, senza alcuna revisione.

A peggiorare la situazione, alcuni materiali presentavano errori lampanti: immagini sgranate o fuori contesto, refusi grossolani, incongruenze concettuali. Elementi che non ci si aspetta da un corso universitario di alto livello, e che hanno fatto scattare il campanello d’allarme. Per Stapleton, il problema non era solo la scarsa qualità didattica, ma soprattutto l’ipocrisia del sistema: mentre agli studenti veniva imposto di non usare strumenti di intelligenza artificiale per i propri compiti, il docente ricorreva all’IA per produrre contenuti destinati a valutare gli stessi studenti, senza trasparenza, senza dichiarazioni, e – secondo la studentessa – senza competenza.

Da qui la decisione di presentare un reclamo formale all’università, chiedendo un rimborso di 8.000 dollari della retta. Un gesto simbolico, certo, ma anche politico: un’accusa diretta contro l’asimmetria di potere e di trattamento tra chi insegna e chi apprende, soprattutto in un’epoca in cui l’intelligenza artificiale sta ridisegnando le regole del gioco.

This woman teaches 10th grade high school in America

She’s leaving the profession. She says kids can no longer read proficiently, they won’t pay attention, won’t listen to authority, they don’t think the Declaration of Independence is important, they’re writing their papers with… pic.twitter.com/q4tM8eKZ9c

— Wall Street Apes (@WallStreetApes) May 12, 2025

L’etica dell’AI nell’istruzione

Questo episodio mette a nudo una delle questioni più spinose dell’era digitale: l’etica dell’intelligenza artificiale nell’istruzione. Da una parte, l’uso di strumenti come ChatGPT può offrire un valido supporto ai docenti nella creazione di materiali didattici, aiutando a velocizzare i processi, generare esempi, arricchire le spiegazioni. In un mondo dove il tempo è sempre meno e le aspettative sempre più alte, l’AI sembra la bacchetta magica perfetta.

Ma, come spesso accade con la magia, il trucco sta nel saperla usare bene – e dichiararlo. Perché quando un professore sfrutta l’intelligenza artificiale per scrivere lezioni e slide, mentre agli studenti viene proibito anche solo di consultarne un paragrafo per i propri compiti, il messaggio implicito è chiaro: “L’IA è utile, ma solo per chi ha il potere di non doverlo giustificare”.

Il risultato? Un cortocircuito etico e pedagogico che mina alla base la fiducia nel patto educativo tra docenti e studenti. Se la tecnologia è proibita a chi impara ma concessa a chi insegna (e nascosta per giunta), allora più che un’università sembra un reality show dove le regole valgono solo per il pubblico, mentre dietro le quinte ci si arrangia come si può.

E diciamolo: se la lezione è stata scritta da ChatGPT, ma non lo si può dire, forse non è l’AI il problema, ma la paura di ammettere che un algoritmo può essere, talvolta, più preparato del docente.

In un contesto così, parlare di etica non è un lusso, è un’urgenza. Perché l’integrazione dell’AI nell’istruzione non può essere una scorciatoia nascosta per l’autorità accademica. Deve essere una scelta consapevole, condivisa e – soprattutto – dichiarata. Altrimenti più che una rivoluzione educativa, rischiamo di vivere un remake scolastico di Black Mirror, ma senza la colonna sonora di qualità.

Verso una coerenza nell’uso dell’AI

Per affrontare queste sfide, è fondamentale che le istituzioni educative stabiliscano linee guida chiare sull’uso dell’IA, promuovendo una cultura di trasparenza e coerenza. Docenti e studenti dovrebbero essere coinvolti in un dialogo aperto sull’integrazione dell’IA nell’apprendimento, garantendo che l’adozione di queste tecnologie avvenga in modo etico e responsabile.

Il caso di Ella Stapleton rappresenta un campanello d’allarme per le università e sottolinea la necessità di affrontare con urgenza le implicazioni etiche dell’uso dell’AI nell’istruzione. Solo attraverso politiche chiare e una comunicazione trasparente sarà possibile integrare l’IA nel processo educativo senza compromettere la qualità e l’integrità dell’insegnamento.