ChatGPT Images 2.0 è il nuovo generatore immagini di OpenAI con ragionamento integrato e fino a otto output coerenti. Cosa è, come funziona, come usarlo al meglio per slide, infografiche, banner, UI mockup e campagne creative.

OpenAI ha rilasciato ChatGPT Images 2.0, il nuovo modello di generazione immagini che gira sul motore tecnico gpt-image-2 ed è disponibile su ChatGPT, Codex e via API. La domanda che si stanno facendo in queste ore i marketing manager, gli editori, le agenzie e i team prodotto è la stessa: cos’è davvero, e soprattutto come usarlo al meglio per ottenere risultati di livello professionale invece di curiosità da feed Instagram. Questa guida risponde ai due quesiti separatamente, partendo dalle basi e arrivando alle tecniche operative che fanno la differenza tra un asset pronto per la stampa e uno che resterà in cartella. Si tratta del passaggio più netto da quando OpenAI aveva integrato Sora dentro ChatGPT, trasformando il prompt in linguaggio visivo: lo stesso movimento, applicato stavolta alla produzione di asset operativi.

Indice dei contenuti

Cos’è ChatGPT Images 2.0

ChatGPT Images 2.0 è il sistema di generazione immagini di OpenAI di terza generazione, dopo gpt-image-1 (aprile 2025) e gpt-image-1.5 (dicembre 2025). Il salto rispetto ai predecessori non è incrementale: per la prima volta un modello di immagini di OpenAI integra in modo nativo le capacità di ragionamento della famiglia “o”, lo stesso paradigma che Digitalic ha analizzato sui modelli o3 e o4-mini e che separa l’intuizione rapida dall’analisi deliberata.

Le caratteristiche tecniche pubbliche sono cinque, e vale la pena tenerle a portata di mano perché orientano tutto il resto. Risoluzione fino a 2K. Supporto per proporzioni da 3:1 a 1:3, quindi banner orizzontali, slide widescreen, poster verticali. Rendering di testo accurato anche in alfabeti non latini come giapponese, coreano, cinese, hindi e bengalese. Generazione fino a otto output coerenti tra loro in un’unica richiesta. Knowledge cutoff dicembre 2025, con possibilità di interrogare il web in tempo reale quando è attiva la modalità di ragionamento.

Sui benchmark Arena gpt-image-2 ha debuttato a 1.512 punti Elo nella categoria text-to-image, con un margine di 242 punti sul secondo classificato, Nano Banana Pro di Google: un divario insolitamente ampio in una classifica dove i modelli di vertice si separano di solito per poche decine di punti.

Come funziona ChatGPT Images 2.0: Instant e Thinking

Il modello opera in due modalità distinte, ed è la prima cosa da capire per usarlo al meglio.

La modalità Instant è la generazione rapida, disponibile a tutti gli utenti ChatGPT e Codex inclusi quelli del piano gratuito. Il modello produce l’immagine attingendo al proprio dataset interno, senza ragionamento esteso e senza ricerca web. È il percorso giusto per illustrazioni veloci, mood, idee visive, prove di stile.

La modalità Thinking è riservata agli abbonati Plus, Pro, Business ed Enterprise. Quando è attiva, il modello prima analizza l’attività richiesta, poi decide se serve una ricerca web per recuperare informazioni aggiornate, poi pianifica la composizione, poi genera, poi verifica i propri output prima di consegnarli. È il primo ciclo agentico esplicito tra prompt e pixel applicato alla generazione visiva. La latenza è maggiore, parliamo di alcuni minuti per output complessi come un fumetto a più riquadri, ma il salto di qualità sui contenuti densi di testo, layout strutturati e dati verificabili è proporzionale.

Per chi sviluppa, il modello è disponibile via API con prezzi che si articolano su tre livelli: 8 dollari per milione di token in input, 2 dollari per gli input cached, 30 dollari per milione di token in output. Il costo per immagine oscilla indicativamente tra 0,04 e 0,35 dollari a seconda di complessità del prompt e risoluzione.

ChatGPT Images 2.0: come usarlo al meglio, la regola dei tre livelli

La differenza tra chi userà ChatGPT Images 2.0 come un giocattolo e chi lo userà come strumento di lavoro sta tutta in una cosa: capire a che livello di precisione si sta giocando, e calibrare il prompt di conseguenza. I livelli sono tre, e non si sovrappongono.

Il livello visivo copre tutto ciò che riguarda mood, atmosfera, palette, suggestione. Per questo livello la modalità Instant è sufficiente, i prompt possono essere descrittivi e poetici, l’AI ha margine di interpretazione. Esempio: “una sala riunioni di un’azienda tech anni Ottanta, luce calda, atmosfera nostalgica”. Il giudizio finale lo dà l’occhio.

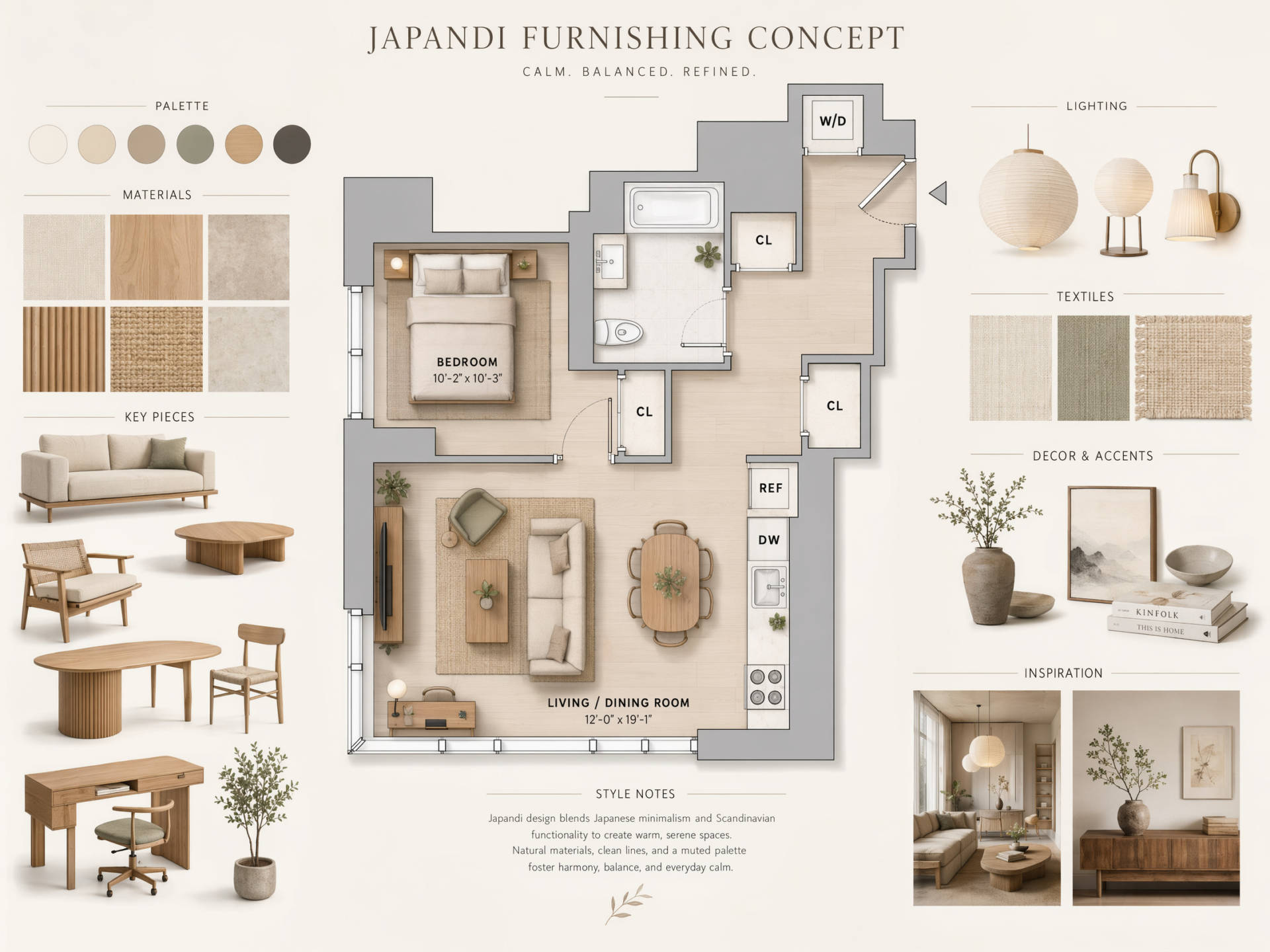

Il livello strutturale copre layout, gerarchia, posizionamento di elementi, formato. Per questo livello serve un prompt che parli come un art director: zone (top-left, fascia centrale, footer), proporzioni esatte (3:1 per banner, 1:3 per stories), gerarchia tipografica (titolo, sommario, body, occhiello). La modalità Thinking diventa utile, soprattutto se gli elementi sono più di tre o quattro.

Il livello informativo copre dati, nomi propri, numeri, date, citazioni, riferimenti reali. Per questo livello la modalità Thinking non è opzionale, è necessaria, perché serve la ricerca web e la verifica; anche con il ragionamento attivo vale una regola che non cambia: ogni dato numerico, ogni nome, ogni cifra che entra in un’infografica generata va controllato a mano contro la fonte primaria. Il modello produce l’immagine, il professionista produce la verità.

I prompt che funzionano davvero su ChatGPT Images 2.0

I prompt che restituiscono risultati professionali con ChatGPT Images 2.0 hanno una struttura ricorrente, vicina a un brief di art direction. Ecco sette schemi pratici, costruiti per casi d’uso B2B reali.

Pattern slide aziendale. “Crea una slide widescreen 16:9 con titolo `[testo del titolo]` in alto a sinistra, occhiello sotto il titolo in colore secondario, immagine principale a destra che occupa il 60 per cento della larghezza, footer con logo segnaposto e data. Stile editoriale corporate, palette navy e bianco, tipografia sans serif moderna.” Funziona perché definisce zone, proporzioni, gerarchia.

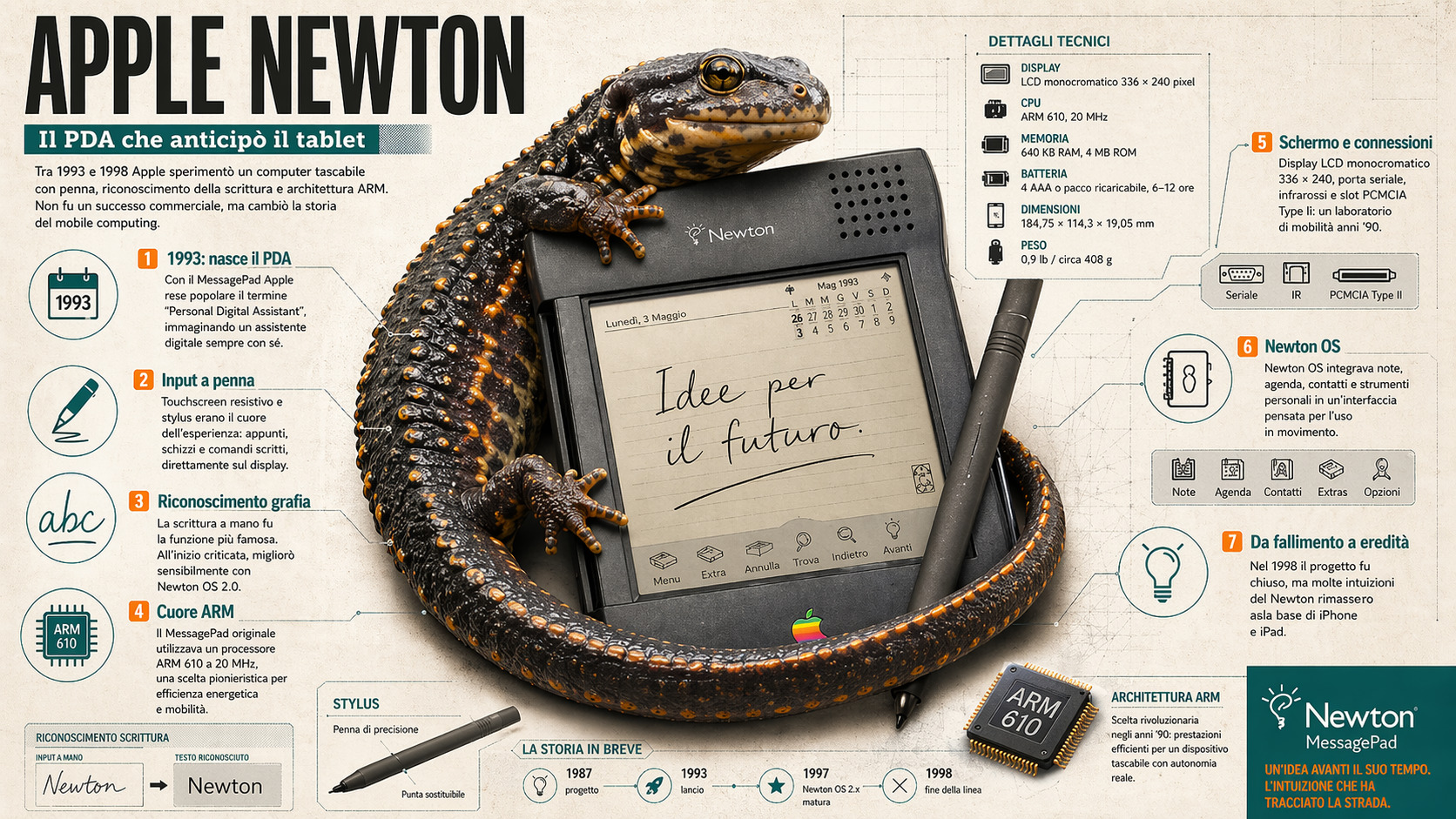

Pattern infografica con dati. “Genera un’infografica verticale 1:2 sull’evoluzione del mercato italiano del cloud 2020-2025. Cerca i dati Anitec-Assinform e Assintel più recenti. Costruisci una timeline orizzontale nella parte superiore, tre KPI in evidenza al centro con icone, fonte e nota metodologica in basso. Tipografia leggibile a 800 pixel di altezza.” La modalità Thinking è obbligatoria. La verifica manuale dei dati anche.

Pattern set di poster coerente. “Crea un set di otto poster per una campagna trimestrale dal titolo `[claim della campagna]`, stessa palette, stessa tipografia, stessa logica compositiva, soggetti diversi: ufficio, sala riunioni, server room, evento, formazione, customer care, R&D, leadership. Formato 4:5, stile fotografico cinematografico.” Sfrutta la coerenza multi-output, che è la vera arma di Images 2.0.

Pattern UI mockup. “Disegna lo screenshot di una dashboard SaaS B2B per il monitoraggio della rete aziendale. Sidebar a sinistra con cinque voci di menu, area centrale con quattro widget (traffico in tempo reale, alert attivi, top device, trend settimanale), header con logo segnaposto e profilo utente. Stile flat moderno, dark theme, testi inglesi leggibili a 1024 pixel.” Il caso d’uso che meglio dimostra il salto: i mockup UI fino a ieri richiedevano Figma, oggi escono in trenta secondi.

Pattern fumetto e storyboard. “Crea uno storyboard di sei vignette su un tecnico di un MSP che gestisce un attacco ransomware: scoperta dell’allarme, escalation, contenimento, comunicazione al cliente, eradicazione, post-mortem. Stile illustrato editoriale, palette tre colori, balloon di dialogo brevi e leggibili.” La coerenza tra le vignette è dove i modelli precedenti fallivano.

Pattern multilingua. “Genera tre varianti dello stesso banner per una campagna pan-europea. Stessa composizione, stessa palette, stesso prodotto al centro, claim tradotto: italiano `[testo]`, francese `[testo]`, tedesco `[testo]`. Formato 16:9.” Il rendering testuale corretto in più lingue su tre output coerenti era impossibile fino a ieri.

Pattern moodboard e progettazione spazi. “Costruisci una moodboard in formato 4:3 partendo da una planimetria fornita, con stile Japandi: zona pranzo, divano, area scrivania, letto matrimoniale, palette neutra con accenti naturali. Includi una griglia con sei riferimenti materici e palette colori in basso.” Caso d’uso interessante per architetti, interior designer, retail manager.

Cinque errori da evitare con ChatGPT Images 2.0

Il primo è chiedere otto cose diverse invece di otto declinazioni della stessa cosa. La generazione multi-output funziona se c’è un pattern; senza pattern produce otto immagini sconnesse.

Il secondo è usare Thinking quando non serve. La modalità Thinking costa tempo e, in API, anche più token di output. Per un’illustrazione veloce è uno spreco. Riservarla a contenuti densi di testo, dati o struttura.

Il terzo è fidarsi dei dati senza verifica. Anche con knowledge cutoff dicembre 2025 e ricerca web, gli errori numerici nelle infografiche generate sono ancora frequenti. La regola editoriale Digitalic vale anche per le immagini: nessun dato pubblicato senza riscontro su fonte primaria.

Il quarto è trattare il prompt come una preghiera. I prompt vaghi producono risultati vaghi. Specificare formato, zone, gerarchia tipografica, palette, stile, riferimenti. Più il brief è preciso, più il risultato è utilizzabile.

Il quinto è non iterare. ChatGPT Images 2.0 mantiene il contesto della conversazione: la prima immagine è raramente quella finale, ma il modello è bravo a correggere se le indicazioni di revisione sono chiare (“sposta il titolo, ingrandisci la foto, cambia la palette in toni freddi”). L’iterazione conversazionale è il vero superpotere rispetto ai modelli a singola passata.

ChatGPT Images 2.0 vs Nano Banana Pro, Midjourney, FLUX

La domanda “qual è il migliore” non ha una risposta sola, perché i quattro contendenti competono su terreni diversi.

Su rendering di testo e layout strutturati gpt-image-2 ha un vantaggio misurabile: i test su griglie con etichette per cella restituiscono risultati ordinati con OpenAI, mescolati con Google. Per chi produce infografiche, dashboard, UI mockup, schede prodotto multilingua, è il singolo elemento che giustifica la scelta. Il salto è particolarmente visibile rispetto al primo generatore di immagini di ChatGPT, che un anno fa aveva aperto la strada alla modifica conversazionale delle foto e oggi mostra tutti i suoi limiti tipografici.

Su ritrattistica e fedeltà fotografica Nano Banana Pro mantiene un margine, soprattutto sulla coerenza del volto attraverso più immagini di riferimento (ne gestisce fino a quattordici in input) e sulla resa di pelle, capelli, illuminazione naturale. Per produzioni e-commerce, fashion, fotografia di prodotto realistica, la scelta razionale resta Google.

Su qualità estetica e controllo dello stile artistico Midjourney V8 resta il riferimento, ma non offre un’API ufficiale: non è una soluzione integrabile in un prodotto o in un workflow automatizzato. Per il direttore creativo che cerca un mood, Midjourney; per lo sviluppatore che integra la generazione, no.

Su flessibilità infrastrutturale FLUX Pro 1.1 di Black Forest Labs occupa il terreno open source, con risultati fotorealistici comparabili e libertà di deployment che gpt-image-2 non concede. Per chi ha vincoli di sovranità del dato o non vuole dipendere da un fornitore unico, è la scelta più pragmatica.

La sintesi onesta è questa: Images 2.0 vince la classifica generalista del momento, ma non vince ovunque. Sceglierlo perché è in cima a un ranking è il modo migliore per spendere male il budget creativo.

Quanto costa e conviene davvero

Per gli utenti ChatGPT, Images 2.0 è incluso nel piano: gratis in modalità Instant, con accesso a Thinking dai piani Plus in su. Per chi sviluppa, l’API gpt-image-2 segue la struttura tariffaria già descritta: 8 dollari per milione di token input, 30 dollari per milione di output, 2 dollari per gli input cached. Il costo per immagine, secondo le stime delle prime ore di test, oscilla tra pochi centesimi e circa un terzo di dollaro.

Il calcolo del ritorno non si fa sul prezzo a immagine, si fa sul numero di passaggi che il modello elimina dal flusso. Una slide deck per un keynote che richiedeva tre ore di compositing tra Photoshop, PowerPoint e illustrazioni AI, oggi può uscire in venti minuti dal solo prompt. Una moodboard di interior design che richiedeva mezza giornata di scouting su Pinterest, oggi è una conversazione di dieci minuti. Il vero benchmark non è il punteggio Elo, è il tempo restituito al cervello per le decisioni che la macchina non sa prendere.

ChatGPT Images 2.0 domande frequenti

ChatGPT Images 2.0 è gratis?

Sì, per gli utenti ChatGPT e Codex, in modalità Instant. La modalità Thinking richiede un abbonamento Plus, Pro, Business o Enterprise.

Quante immagini posso generare in una richiesta?

Fino a otto, e il modello mantiene coerenza visiva tra tutte. È la base per storyboard, set di poster, campagne multi-formato.

Posso usarlo via API?

Sì, il modello sottostante si chiama gpt-image-2 ed è disponibile via API standard di OpenAI. Pricing: 8 dollari per milione di token input, 30 dollari per milione di output.

Funziona in italiano?

Sì, sia per i prompt sia per il rendering del testo nelle immagini, con un livello di accuratezza tipografica molto superiore alle versioni precedenti.

Cosa fa che gli altri non fanno?

La combinazione di ragionamento prima della generazione, ricerca web integrata e otto output coerenti in una sola richiesta è oggi un’esclusiva di OpenAI. I concorrenti coprono singoli pezzi, nessuno il pacchetto completo.

Sostituisce Photoshop, Figma o Midjourney?

No. Comprime il flusso, riduce i passaggi intermedi, ma non sostituisce il giudizio professionale né il controllo fine sul pixel. Lo strumento giusto per ogni livello del lavoro resta una scelta umana. Resta il punto che ogni rilascio di questo livello pone, e che nessun blog post di un fornitore può chiudere: a forza di trasferire pezzi del processo creativo dentro l’AI, cosa stiamo lasciando alla mano umana, e cosa stiamo prendendo in cambio. La risposta non sta nelle release notes; sta nel modo in cui ogni redazione, ogni agenzia, ogni team prodotto deciderà di usare il modello da lunedì mattina, e in quello che sceglierà di non delegare.