AI Act, sanzioni fino a 35 milioni di euro o il 7% del fatturato globale. La data che ogni CIO italiano dovrebbe avere in calendario, e che quasi nessuno ha

Conto alla rovescia per l’ AI Act: cento giorni, mancano solo 100 giorni. Dovrebbe esserci un calendario appeso alla parete dell’ufficio con un cerchio rosso intorno al 2 agosto 2026, e accanto un foglio A4 con l’elenco dei sistemi AI da certificare entro quella data, in Italia, non ho visto uffici compliance in cui la data sia stata è cerchiata, forse perchè è Agosto e si sa, in Italia ad agosto non succede nulla, poi l’elenco dei sistemi AI in produzione, semplicemente, molto spesso non esiste.

È in questa distanza che si gioca la partita dei prossimi quattro mesi: il 2 agosto 2026 il Regolamento europeo 2024/1689 sull’intelligenza artificiale entra nella sua fase più dura, quella che trasforma l’AI Act da impianto giuridico annunciato a strumento operativo con poteri sanzionatori reali, autorità di vigilanza nazionali, valutazioni di conformità obbligatorie. Cento giorni in cui il sistema produttivo italiano deve fare quello che ha rinviato troppo a lungo. Cento giorni che separano un Paese strutturalmente in ritardo dal primo banco di prova vero.

Indice dei contenuti

AI Act, sintesi della prima legge al mondo sull’intelligenza artificiale

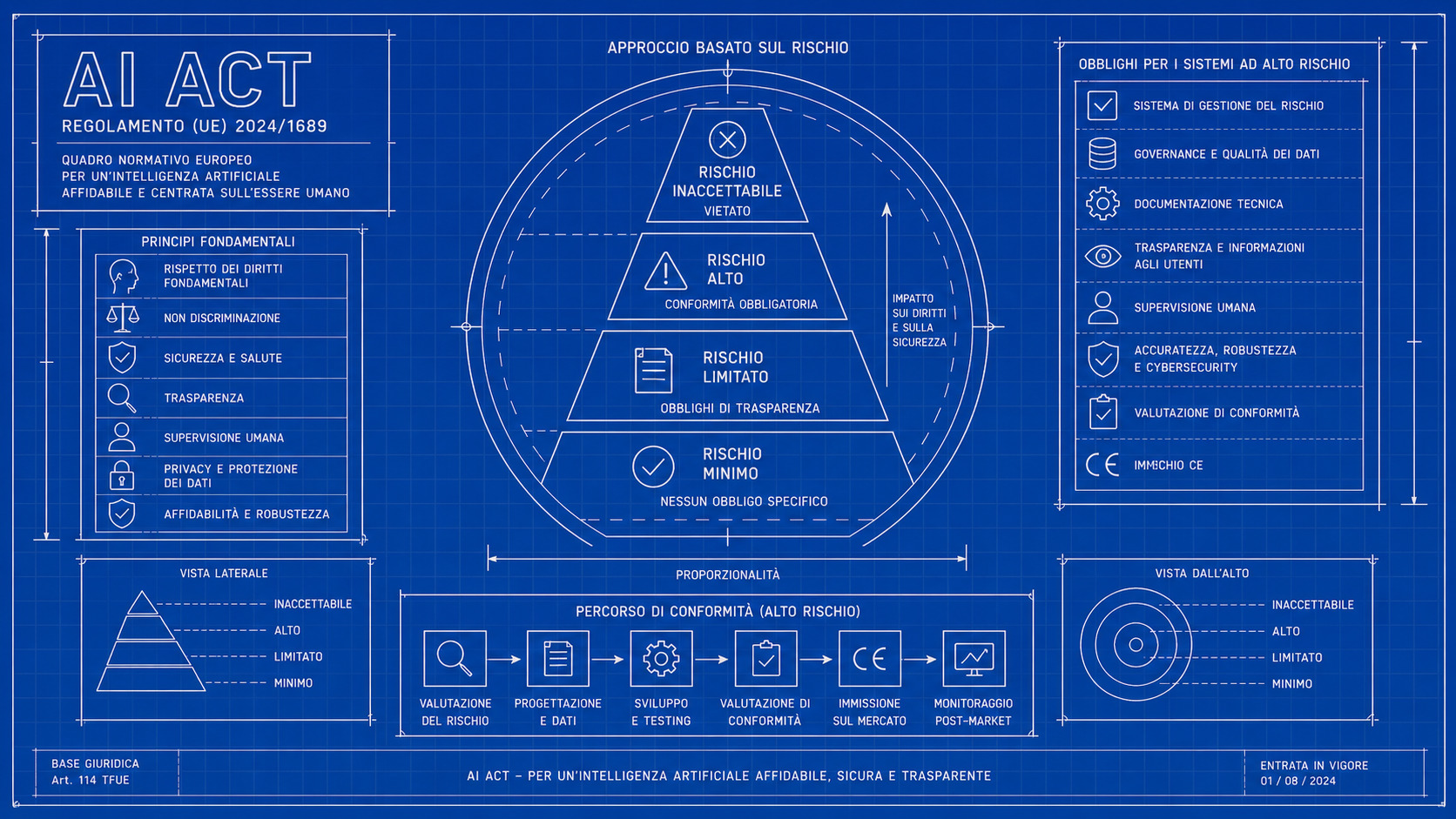

L’AI Act è il primo quadro normativo organico al mondo sull’intelligenza artificiale, adottato dall’Unione Europea con il Regolamento 2024/1689 del 13 giugno 2024 e pubblicato in Gazzetta Ufficiale dell’UE il 12 luglio dello stesso anno. La logica è basata sul rischio: ogni sistema AI viene classificato in quattro categorie, rischio inaccettabile (vietato), alto rischio (obblighi stringenti), rischio limitato (obblighi di trasparenza), rischio minimo (libero utilizzo). Da questa classificazione discendono tutti gli obblighi che le aziende sono chiamate a rispettare a seconda del proprio ruolo nella catena del valore.

Il testo integrale dell’AI Act è consultabile sull’EUR-Lex e sulla pagina ufficiale della Commissione europea, che funge anche da repository per le linee guida operative, i Code of Practice e la documentazione di supporto pubblicata dall’AI Office. La sintesi essenziale che ogni decision maker deve avere chiara è questa: non si tratta di una direttiva da recepire Stato per Stato, ma di un Regolamento direttamente applicabile in tutti i 27 Paesi membri, con effetti immediati sulle aziende e con un perimetro extraterritoriale che lo rende il primo standard globale di fatto sull’AI.

Quando entrano in vigore i principali obblighi dell’AI Act

L’AI Act è entrato in vigore il 1° agosto 2024, ma la sua applicazione segue un calendario scaglionato. Le pratiche vietate dell’Articolo 5 (social scoring, manipolazione subliminale, riconoscimento delle emozioni sul lavoro, identificazione biometrica in tempo reale negli spazi pubblici) e gli obblighi di alfabetizzazione AI sono operativi dal 2 febbraio 2025. Le regole sui modelli General Purpose AI sono applicative dal 2 agosto 2025, come avevamo raccontato nel pezzo dedicato alla fase GPAI dell’AI Act. Sono passaggi che il sistema enterprise ha più o meno digerito, perché coinvolgevano principalmente i provider dei foundation model, non chi quei modelli li integra.

Il 2 agosto 2026 cambia tutto. Si attiva il corpo principale del Regolamento: obblighi stringenti per i sistemi ad alto rischio dell’Allegato III, regole di trasparenza dell’Articolo 50, obbligo per ogni Stato membro di istituire almeno un AI Sandbox nazionale. Il 2 agosto 2027 estende il regime ai sistemi ad alto rischio integrati come componenti di sicurezza in prodotti già regolati a livello europeo, dispositivi medici, macchinari, giocattoli. Tra le due date c’è la finestra in cui il sistema delle imprese gioca la partita.

Chi arriva al 2026 senza inventario, senza classificazione del rischio, senza un Fundamental Rights Impact Assessment integrato con la DPIA del GDPR, non ha più il tempo di costruirseli in corso d’opera. Non è una valutazione catastrofista, è aritmetica.

Chi è soggetto all’AI Act, una mappa che spiazza

La domanda più frequente che ricevo dai CIO è anche quella che produce le risposte più sbagliate: chi deve preoccuparsi davvero dell’AI Act? La risposta breve è “praticamente tutti”, la risposta lunga richiede di capire il modello a quattro ruoli del Regolamento. Il provider è chi sviluppa o fa sviluppare un sistema AI e lo immette sul mercato sotto il proprio nome o marchio. Il deployer è chi utilizza un sistema AI sotto la propria autorità nell’ambito di un’attività professionale, ed è qui che ricadono la stragrande maggioranza delle aziende italiane. L’importatore è chi immette sul mercato europeo un sistema AI di un soggetto extra-UE. Il distributore mette a disposizione il sistema senza modificarlo.

Il punto critico è che le obbligazioni si attivano in base al ruolo concreto, non a quello dichiarato in contratto. Se un’azienda italiana acquista un assistente AI per il recruiting da un fornitore americano e lo personalizza in modo significativo, secondo le linee guida dell’AI Office può diventare provider della versione modificata, ereditando un set di obblighi molto più pesante di quello del semplice deployer. Anche le aziende non europee che immettono sistemi AI nel mercato UE o i cui output sono usati in Europa rientrano nel perimetro del Regolamento, esattamente come è successo con il GDPR. Questo è il cuore dell’effetto extraterritoriale che fa dell’AI Act il primo standard globale di fatto.

L’AI Act italiano: il nodo della Legge 132 e il ruolo di ACN

Sul piano italiano il quadro si è complicato il 10 ottobre 2025, data di entrata in vigore della Legge 23 settembre 2025 numero 132, che fa dell’Italia il primo Paese dell’Unione con un quadro nazionale organico interamente allineato all’AI Act. Quando si parla di “AI Act italiano” è alla 132 che si sta facendo riferimento, anche se tecnicamente la legge nazionale non sostituisce il Regolamento europeo, lo integra. Designa l’Agenzia per la Cybersicurezza Nazionale (ACN) come autorità di vigilanza, attribuisce all’Agenzia per l’Italia Digitale (AgID) la gestione delle notifiche, stanzia un programma di investimenti per startup e PMI nei settori AI e cybersicurezza, introduce nuove fattispecie di reato contro l’uso fraudolento dell’intelligenza artificiale, deepfake lesivi compresi.

Il CIO italiano quindi non sta gestendo un solo perimetro normativo. Ne sta gestendo due. Come avevamo già spiegato nella guida alle nuove norme AI per le PMI, la Legge 132 modifica anche il Modello 231, introducendo responsabilità organizzative aggiuntive che fino al 9 ottobre 2025 semplicemente non esistevano. Due binari, una sola scadenza. Chi pianifica adeguamento solo sull’Europa fa metà del lavoro.

AI Act sanzioni: fino al 7% del fatturato globale, e per l’Italia c’è di più

Le sanzioni dell’AI Act sono state calibrate per essere più dure di quelle del GDPR, e per buone ragioni. Le aziende italiane rispondono a sanzioni amministrative europee fino a 35 milioni di euro o il 7% del fatturato globale annuo per le violazioni più gravi, quelle relative all’uso di pratiche AI vietate dall’Articolo 5. Per la non conformità agli obblighi sui sistemi ad alto rischio, comprese le mancanze documentali, di valutazione del rischio o di sorveglianza umana, la sanzione arriva fino a 15 milioni o il 3%. Per informazioni false, incomplete o ingannevoli fornite alle autorità di vigilanza, la sanzione si ferma a 7,5 milioni o l’1,5%.

Le PMI e le startup beneficiano del meccanismo della “soglia inferiore”: tra l’importo fisso e la percentuale sul fatturato si applica il valore più basso, una scelta del legislatore europeo per evitare che la compliance diventi una barriera all’ingresso per le piccole imprese. In parallelo, in Italia, opera il sistema sanzionatorio nazionale sotto la 132, che per chi opera sotto la giurisdizione italiana può tradursi in conseguenze 231 ben più temibili di una multa amministrativa: responsabilità penale, interdittive, danno reputazionale e, in alcuni settori regolati, perdita dell’autorizzazione operativa.

Il Digital Omnibus e l’illusione del rinvio

A complicare ulteriormente la lettura c’è il Digital Omnibus presentato dalla Commissione il 19 novembre 2025, una proposta di semplificazione che, tra le altre cose, suggerisce di spostare fino a un massimo di sedici mesi la timeline dei sistemi ad alto rischio. Si tratta di una proposta in fase di negoziato tra Parlamento europeo e Consiglio dell’Unione, secondo quanto pubblicato nella pagina ufficiale della Commissione sull’AI Act. L’esito non è scontato e i tempi non garantiscono nulla a chi vorrebbe metterci sopra una pianificazione 2026.

Qui si gioca la trappola più rischiosa per il decision maker italiano: assumere il rinvio come dato di fatto, e basarci sopra il piano di compliance. Significa giocare contro la propria azienda. Se il Digital Omnibus non chiude prima dell’estate, la timeline originaria torna automaticamente operativa. Le agende dei notified bodies, gli organismi terzi che rilasciano le certificazioni di conformità, sono già sature verso il secondo trimestre 2026. Chi parte tardi non trova interlocutori disponibili, qualunque cosa decida Bruxelles.

Un percorso completo di adeguamento per un sistema ad alto rischio, comprensivo di analisi, implementazione tecnica, governance e audit, richiede mediamente tra otto e quattordici mesi di lavoro effettivo. Aprile 2026 più otto mesi minimi porta a dicembre, oltre il 2 agosto, e questo nell’ipotesi più ottimistica di un’organizzazione già strutturata. Per chi parte da zero parliamo di gennaio 2027 nelle proiezioni meno crudeli. Pensare che il rinvio risolva il problema è la versione 2026 dello “abbiamo ancora tempo” del 2017 sul GDPR.

L’Italia di aprile 2026, raccontata dai numeri

L’indagine ISTAT certificata nel dicembre 2025 fotografa un’accelerazione potente: il 16,4% delle imprese italiane con almeno 10 addetti utilizza oggi almeno una tecnologia di intelligenza artificiale, contro l’8,2% del 2024 e il 5% del 2023. Un raddoppio in dodici mesi, un quadruplicamento in due anni. Numeri che dovrebbero rassicurare. Il problema è il rovescio della medaglia: lo stesso ISTAT segnala che quasi il 60% delle aziende che ha valutato investimenti in AI vi ha rinunciato per mancanza di competenze adeguate, e tra le PMI che adottano l’intelligenza artificiale oltre un’impresa su quattro non sa indicare un ambito aziendale specifico di utilizzo.

Si compra tecnologia senza saperla governare. Si firma un contratto con un vendor di Copilot perché lo fanno tutti, senza chiedersi se quel deployment ricade nell’Allegato III. Si lancia un agente AI di onboarding HR senza realizzare che gli strumenti AI per la gestione dei lavoratori, screening dei CV inclusi, sono per definizione ad alto rischio. È lo scenario su cui atterra il 2 agosto 2026.

Lo studio appliedAI, che ha analizzato 106 sistemi AI in produzione nelle imprese europee, ha rilevato che il 40% aveva una classificazione del rischio non chiara o non documentata. Tradotto in linguaggio operativo: quattro sistemi su dieci non sapevano se erano ad alto rischio, a rischio limitato o minimo, e quindi non sapevano quali obblighi avrebbero dovuto rispettare a partire dal 2 agosto. È il dato che dovrebbe togliere il sonno a chi firma le decisioni IT.

Il costo reale della compliance, cifre alla mano

Il costo della conformità per un singolo sistema AI ad alto rischio è stimato intorno a 52.000 euro l’anno secondo le proiezioni più recenti, una cifra che include risk assessment, documentazione tecnica conforme all’Articolo 11, sistema di gestione della qualità, monitoraggio post-immissione, conservazione dei log per la tracciabilità prevista dall’Articolo 12. Le valutazioni di conformità con organismo notificato per i sistemi ad alto rischio possono costare tra 5.000 e 50.000 euro a sistema.

Per un’azienda media italiana che ha messo in produzione, magari senza saperlo, tre o quattro sistemi che ricadono nelle categorie dell’Allegato III, parliamo di un investimento annuale tra 150.000 e 200.000 euro, da ammortizzare su un orizzonte di compliance pluriennale. Sembra molto. Lo è meno se confrontato con le alternative: sanzioni europee al 7% del fatturato globale, sanzioni nazionali sotto la 132, sospensione del deployment, recall di prodotto, perdita di accesso al mercato unico, contenziosi civili sui diritti fondamentali violati. Quando un capitolato di gara internazionale inizierà a chiedere la conformità AI Act come prerequisito di partecipazione, e succederà entro il 2027, chi non ce l’ha non corre per il contratto, lo guarda passare.

AI Act: tre cose da fare luglio 2026

In una recente conversazione con il responsabile compliance di un gruppo industriale lombardo da 400 milioni di fatturato, ho posto una domanda semplice: quanti sistemi AI avete in produzione? La risposta è stata: “Dipende da come li definiamo”. Tre ore dopo, il loro CIO mi ha mandato un’email con un primo elenco. Erano undici. Quattro non erano stati formalmente acquistati dall’IT, due erano embedded in software gestionali aggiornati l’anno scorso senza che nessuno notasse il cambio di natura. Da lì sono partiti, nel modo giusto.

Quel modo giusto si articola in tre passaggi.

L’inventory. Una mappatura completa di ogni sistema AI in uso, in sviluppo, in fase di acquisizione, comprensiva di shadow AI introdotta dai team di business senza passare dall’IT, classificata per ruolo dell’azienda nella catena del valore (provider, deployer, importatore, distributore) e per livello di rischio dell’Allegato III. Quattro o sei settimane di lavoro reale, che producono una consapevolezza organizzativa che oggi semplicemente non esiste. Senza l’inventory, ogni azione successiva è una scommessa.

La governance integrata. L’AI Act non vive da solo: convergono nel 2026 GDPR, NIS2, Cyber Resilience Act, Direttiva Macchine, DORA per il settore finanziario. Il Fundamental Rights Impact Assessment richiesto dall’Articolo 27 dell’AI Act si sovrappone in larga parte alla Data Protection Impact Assessment dell’Articolo 35 GDPR. Eseguire i due assessment come esercizi separati raddoppia i costi e moltiplica gli errori. Il framework giusto li integra una volta sola, con esiti coerenti, sotto un unico comitato di governance.

Il design for compliance. Ogni nuovo progetto AI dovrebbe nascere già allineato ai requisiti high risk, anche se oggi non rientra formalmente in quella classificazione, perché l’esperienza GDPR ha insegnato che retrofittare la conformità su sistemi già in produzione costa cinque volte di più che progettarla dall’inizio. Tracciabilità, explainability, supervisione umana, cybersecurity sono caratteristiche che vanno scritte in fase di architettura, non appiccicate dopo. Chi progetta oggi senza considerare l’AI Act sta costruendo un debito tecnico-regolatorio che presenterà il conto, con interessi.

Il responsabile compliance lombardo, all’ultima riunione, ha detto una frase che mi è rimasta. “Non stiamo facendo compliance perché abbiamo paura della multa. La stiamo facendo perché vogliamo poter dire ai nostri clienti francesi e tedeschi che siamo pronti prima di loro”. È esattamente lo spostamento di prospettiva che separa chi reagisce da chi anticipa.

L’effetto internazionale dell’AI Act, dal Brussels Effect allo standard globale

Quando il GDPR è entrato in vigore nel 2018, gli analisti americani lo dipingevano come un peso normativo destinato a rallentare l’innovazione europea. Nel 2026 è diventato lo standard di fatto della protezione dati a livello globale, copiato da California (CCPA), Brasile (LGPD), India (DPDPA), Cina (PIPL). È quello che gli accademici chiamano Brussels Effect: la capacità del mercato unico europeo di esportare regole, in virtù delle sue dimensioni e della sua attrattività commerciale.

L’AI Act sta seguendo la stessa traiettoria con un’accelerazione superiore. Il Brasile ha approvato il proprio quadro AI ispirato al modello europeo nel 2025. Il Canada e l’Australia stanno procedendo con framework convergenti. Persino lo Stato di New York ha pubblicato linee guida che mutuano la classificazione del rischio europea. Per le aziende italiane questo significa che la conformità all’AI Act non sarà solo un obbligo per vendere in Europa, sarà un passaporto operativo per accedere a un numero crescente di mercati globali. Esattamente come oggi nessuno mette in discussione di dover essere GDPR-compliant per fare e-commerce internazionale.

Il vantaggio competitivo nascosto nella scadenza

Oltre 230 grandi organizzazioni globali, tra cui Allianz, Lenovo, Reply, Kaspersky, hanno già aderito all’AI Pact della Commissione, l’iniziativa volontaria che impegna a rispettare gli obblighi dell’AI Act in anticipo. Nessuna di queste organizzazioni lo sta facendo per filantropia. Lo sta facendo perché ha capito che la compliance, una volta diventata standard di mercato, smette di essere costo e inizia a essere credenziale. Le aziende italiane che oggi rispondono a bandi internazionali, che vogliono entrare in supply chain europee, che vendono a clienti enterprise tedeschi o francesi, scopriranno presto che la conformità all’AI Act sarà richiesta nei capitolati come oggi è richiesta la certificazione ISO 27001.

Chi arriva al 2 agosto 2026 con la documentazione in ordine non sta solo evitando sanzioni: sta costruendo un posizionamento. La scadenza europea diventa, paradossalmente, uno degli strumenti più potenti per ridurre la distanza che separa il manifatturiero italiano dai concorrenti tedeschi sulla maturità digitale.

Cento giorni alla data, otto-quattordici mesi di lavoro per arrivarci preparati. La matematica non torna per chi inizia oggi sulla nuda. Torna ancora per chi inizia oggi e accetta di concentrare le risorse sui sistemi più critici, lasciando il perimetro minore alla seconda ondata. Quel calendario tedesco con il 2 agosto cerchiato in rosso, in qualche ufficio compliance italiano, qualcuno dovrà pure iniziare a tirarlo fuori dal cassetto.

FAQ domande frequenti sull’AI Act

Cos’è l’AI Act in sintesi? L’AI Act è il Regolamento UE 2024/1689, prima legge organica al mondo sull’intelligenza artificiale, entrata in vigore il 1° agosto 2024. Classifica i sistemi AI in quattro livelli di rischio (inaccettabile, alto, limitato, minimo) e impone obblighi proporzionali al rischio. È direttamente applicabile in tutti i 27 Paesi UE.

Quando entrano in vigore i principali obblighi dell’AI Act? Le pratiche vietate sono operative dal 2 febbraio 2025, gli obblighi GPAI dal 2 agosto 2025, gli obblighi sui sistemi ad alto rischio dell’Allegato III dal 2 agosto 2026, gli obblighi sui sistemi ad alto rischio integrati in prodotti regolati dal 2 agosto 2027. La piena applicazione del Regolamento è il 2 agosto 2026.

Chi è soggetto all’AI Act? Provider, deployer, importatori e distributori di sistemi AI immessi sul mercato europeo o utilizzati nell’UE, indipendentemente dalla sede legale dell’azienda. L’effetto extraterritoriale rende il Regolamento applicabile anche ad aziende non europee i cui sistemi o output sono usati in Europa.

A quanto ammontano le sanzioni dell’AI Act? Fino a 35 milioni di euro o il 7% del fatturato globale annuo per pratiche vietate. Fino a 15 milioni o il 3% per non conformità sui sistemi ad alto rischio. Fino a 7,5 milioni o l’1,5% per informazioni false alle autorità. Per le PMI si applica il valore più basso tra cifra fissa e percentuale.

Esiste una versione italiana dell’AI Act? L’AI Act è un Regolamento europeo direttamente applicabile, non viene “tradotto” in legge italiana. Tuttavia l’Italia ha approvato la Legge 132/2025, in vigore dal 10 ottobre 2025, che integra il Regolamento europeo designando ACN come autorità di vigilanza, AgID come gestore delle notifiche, e introducendo nuove fattispecie di reato per uso fraudolento dell’AI.

Dove trovo il testo ufficiale dell’AI Act? Il testo integrale è pubblicato su EUR-Lex (Regolamento UE 2024/1689) ed è disponibile in tutte le lingue ufficiali dell’Unione, italiano compreso. La pagina ufficiale della Commissione raccoglie inoltre linee guida operative, Code of Practice e materiali di supporto pubblicati dall’AI Office.